Das auf künstlicher Intelligenz (KI) basierende Softwaretool ChatGPT ist derzeit in aller Munde. Aber wie funktioniert es eigentlich? Welche Chancen und Risiken birgt es? Unser AUVA-Experte für Maschinensicherheit und Digitalisierung, DI Viktorijo Malisa, hat dafür mit der KI ein dreiteiliges Interview zum Thema „Arbeitssicherheit“ geführt und Interessantes herausgefunden.

Autor:

DI Viktorijo Malisa, Fachbereich Maschinensicherheit und Digitalisierung, AUVA-Hauptstelle, viktorijo.malisa@auva.at

Bei ChatGPT handelt es sich um die Beta-Version eines Chats, also eines textbasierten Dialogsystems. Da das Softwaretool auf künstlicher Intelligenz basiert, wollte ich herausfinden, was der Chat leisten kann, wie das Tool funktioniert und was es über Arbeitssicherheit weiß. Um die Hintergründe zu beleuchten, habe ich einen Test gestartet und ChatGPT ganz einfach zum Thema Arbeitssicherheit befragt. Das Interview inklusive Fazit können Sie hier nachlesen:

Wie funktioniert der Dialog mit Chat GPT?

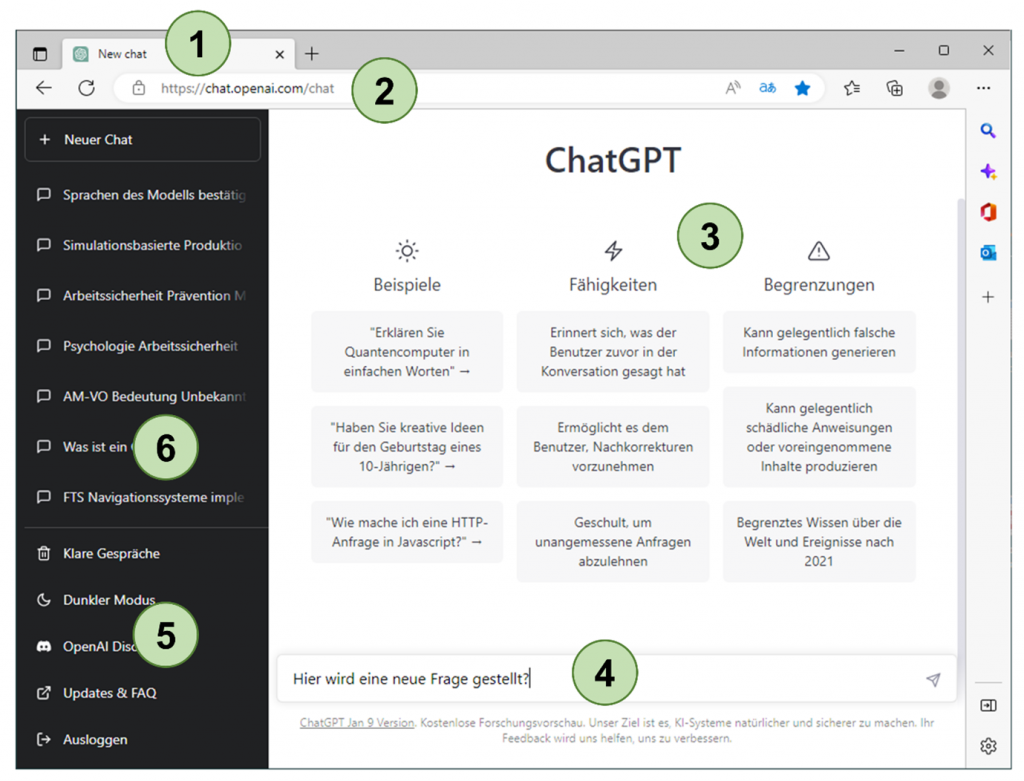

Zu Beginn habe ich die Standard-Webanwendung für PC getestet (siehe Abbildung 1). Die Startseite des Chats ist übersichtlich und einfach gestaltet. In den Eigenschaften wird unter „Begrenzungen“ auf Einschränkungen des Chats hingewiesen:

- KI kann gelegentlich falsche Informationen generieren

- KI kann gelegentlich schädliche Anweisungen oder voreingenommene Inhalte produzieren

- KI hat begrenztes Wissen über die Welt und Ereignisse nach 2021

Der Dialog (Chat) kann direkt von der Web-Startseite mit einer Frage gestartet werden. Anhand der ersten Frage wird automatisch ein Titel für den Chat-Dialog erstellt. Der Titel kann nachträglich jederzeit geändert werden. Es ist vorgesehen, dass der Chat-Titel zu einem bestimmten Thema passt. Wenn eine Frage nicht zum Thema und damit zum Chat-Titel passt, sollte mit „Neuer Chat“ begonnen werden. Die gesamte Korrespondenz wird gespeichert und kann zu jedem Zeitpunkt gelöscht werden. Nachträglich kann der Chat zu jedem Thema auch wieder fortgesetzt werden. Die KI weiß, was bereits gefragt wurde und was sie als Ergebnis geliefert hat. Wird eine Frage wiederholt, versucht die KI neue Informationen zu liefern oder die bestehende Antwort umzuformulieren.

Übrigens: „Microsoft warnt seine Mitarbeiter:innen davor, „sensible Daten“ mit ChatGPT zu teilen“ (Kim, 2023). Der Grund dafür ist, dass die von den Nutzenden eingegebenen vertraulichen Daten für das Training zukünftiger Modelle dieser KI verwendet werden können. Das bedeutet, dass diese Daten anschließend allen anderen Nutzenden zugänglich gemacht werden.

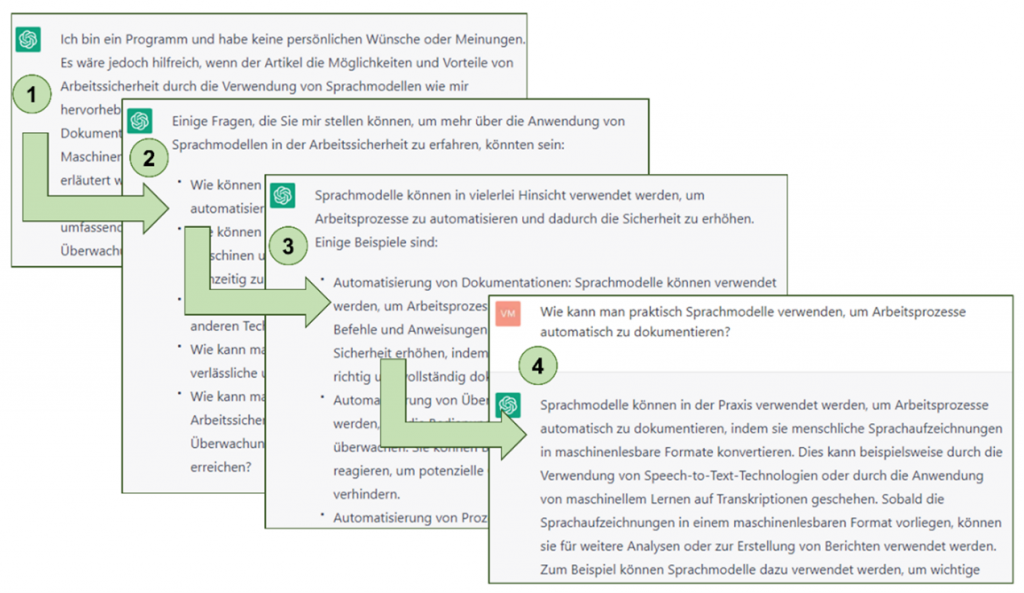

Abbildung 2 zeigt schematisch die Strategie des Dialogs, um von der KI strukturiert mehr Informationen zu einem bestimmten Thema zu erhalten. Zunächst wird eine allgemeine Frage zu einer Definition oder einem Begriff gestellt, z. B. Was ist Arbeitssicherheit? In der zweiten Frage wird nach der Eigenschaft oder den Hauptbestandteilen des Begriffs gefragt, dann wird eine spezifische Frage zu einer der Eigenschaften gestellt. Und die vierte Ebene wäre eine Frage zu den Beispielen für bestimmte Eigenschaften. Konkrete Informationen über ein Beispiel bekommt man nicht, da die KI noch nicht über derartige Informationen verfügt.

3 – Frage über Parameter/Eigenschaft, 4 – Beispiel

Interview Teil 1: "Die KI übernimmt das Ruder"

Im ersten Teil des Interviews überließ ich der KI das Ruder. Ich war neugierig, was herauskommt, wenn ChatGPT die Fragen zu Arbeitssicherheit selbst definiert.

Anmerkung: Die KI spricht User:innen in der deutschen Sprache mit „Sie“ an. Daher habe ich diese Höflichkeitsform in meinen Fragen beibehalten. Ein geschlechtergerechter Sprachgebrauch ist aufgrund der automatisierten Computer-Antwort leider nicht möglich.

AUVA: Was hätten Sie gerne, dass wir in unserem Interview zu dem Thema Arbeitssicherheit diskutieren?

ChatGPT: Als KI-Modell kann ich keine eigenen Vorlieben oder Präferenzen haben, aber ich kann Ihnen Informationen und Fakten zu verschiedenen Aspekten der Arbeitssicherheit bereitstellen. Zum Beispiel könnten wir über die Bedeutung von Arbeitssicherheit sprechen, die verschiedenen Gesetze und Vorschriften, die dafür sorgen, dass Arbeitsplätze sicher sind, oder auch über die Rolle, die Technologie und KI in der Arbeitssicherheit spielen kann.

AUVA: Welche Fragen sollten wir Ihnen zu diesem Thema stellen?

ChatGPT: Vielen Dank, das ist ein interessantes Thema. Als KI-Modell bin ich nicht in der Lage, Bedürfnisse oder Wünsche zu haben, aber hier sind einige Vorschläge für Fragen, die Sie mir zum Thema Arbeitssicherheit stellen könnten:

- Wie kann KI bei der Verbesserung der Arbeitssicherheit in der Industrie helfen?

- Inwieweit kann KI in der Vorhersage von Arbeitsunfällen und der Verhinderung von Gefahren eingesetzt werden?

- Wie können Unternehmen die Einhaltung von Arbeitssicherheitsvorschriften überwachen und sicherstellen, dass Mitarbeiter sicher arbeiten?

- Wie kann KI eingesetzt werden, um die Schulung von Mitarbeitern zu unterstützen und sicherzustellen, dass sie über die erforderlichen Fähigkeiten und Kenntnisse verfügen, um sicher zu arbeiten?

- Wie kann KI bei der Überwachung von Arbeitsbedingungen und der Identifizierung von Risiken eingesetzt werden?

AUVA: Vielen Dank, all das sind alle interessante Themen, daher hier die erste von Ihnen genannte Frage: Wie kann KI bei der Verbesserung der Arbeitssicherheit in der Industrie helfen?

ChatGPT: KI kann bei der Verbesserung der Arbeitssicherheit in der Industrie auf verschiedene Weise helfen:

- Überwachung von Prozessen: KI kann mittels Computer Vision und maschinellem Lernen Anomalien in Prozessen automatisch erkennen und eine frühzeitige Alarmierung auslösen, bevor ein Unfall passiert.

- Vorhersage von Unfällen: KI kann verwendet werden, um Trends und Muster in Unfalldaten zu erkennen und Vorhersagen für zukünftige Unfälle zu treffen, um Maßnahmen ergreifen zu können, bevor sie passieren.

- Schulung und Aufklärung: KI kann verwendet werden, um interaktive Schulungen und Übungen zu erstellen, die Mitarbeiter auf potenzielle Gefahren am Arbeitsplatz aufmerksam machen.

- Überwachung von Arbeitsbedingungen: KI kann auch verwendet werden, um kontinuierlich die Umgebungsbedingungen am Arbeitsplatz zu überwachen, einschließlich Lärmpegel, Temperatur und Feuchtigkeit, und Alarm auszulösen, wenn Gefahren für die Gesundheit und Sicherheit der Mitarbeiter vorliegen.

- Optimierung von Arbeitsabläufen: KI kann auch verwendet werden, um Arbeitsabläufe zu optimieren und mögliche Sicherheitsrisiken zu minimieren.

Es ist wichtig zu betonen, dass die Verwendung von Sprachmodellen zur Automatisierung von Arbeitsprozessen und zur Erhöhung der Arbeitssicherheit nur ein Teil eines umfassenderen Ansatzes sein sollte, der auch Schulungen und manuelle Überwachung umfasst.

AUVA: Ok, hat sich damit die Sicherheit am Arbeitsplatz erhöht?

ChatGPT: Es ist richtig, dass die Implementierung von KI allein nicht automatisch zu einer Verbesserung der Arbeitssicherheit führt. Es handelt sich hierbei jedoch um ein Werkzeug, das eine Unterstützung darstellen kann, wenn es in Kombination mit anderen Maßnahmen eingesetzt wird. Zum Beispiel kann KI bei der Überwachung von Arbeitsprozessen eingesetzt werden, um mögliche Gefahren frühzeitig zu erkennen und dadurch ein schnelleres Handeln zu ermöglichen. Auch die Analyse von Daten zur Arbeitssicherheit kann durch KI unterstützt werden, um Muster und Trends zu erkennen, die zu einer verbesserten Prävention beitragen können. Es ist jedoch wichtig zu beachten, dass eine solche Implementierung von KI gut geplant und durchgeführt werden muss, um sicherzustellen, dass sie tatsächlich zu einer Verbesserung der Arbeitssicherheit beiträgt.

AUVA: Inwieweit kann KI in der Vorhersage von Arbeitsunfällen und der Verhinderung von Gefahren eingesetzt werden?

ChatGPT: KI kann in der Vorhersage von Arbeitsunfällen und der Verhinderung von Gefahren auf verschiedene Arten eingesetzt werden, einschließlich maschinellem Lernen, Prozessoptimierung und computergestützter Überwachung. Beispiele für ihre Anwendung umfassen die Analyse von Daten zu früheren Unfällen, die Überwachung von Arbeitsbedingungen in Echtzeit und die Vorhersage von potenziellen Gefahren basierend auf Umweltfaktoren.

KI-Systeme können auch verwendet werden, um Arbeiter zu schulen und zu unterstützen, indem sie ihnen relevante Sicherheitsinformationen und Anweisungen bereitstellen.

Es ist jedoch wichtig zu beachten, dass KI-Systeme nicht perfekt sind und menschliche Überwachung und Entscheidungen erfordern können. Es ist auch wichtig, Datenschutz- und ethische Überlegungen bei der Verwendung von KI in sicherheitskritischen Umgebungen zu berücksichtigen.

AUVA: Wie können Unternehmen die Einhaltung von Arbeitssicherheitsvorschriften überwachen und sicherstellen, dass Mitarbeiter:innen sicher arbeiten?

ChatGPT: Unternehmen können die Einhaltung von Arbeitssicherheitsvorschriften auf verschiedene Arten überwachen und sicherstellen, dass Mitarbeiter sicher arbeiten, einschließlich:

- Schulung: Regelmäßige Schulungen für Mitarbeiter, um sicherzustellen, dass sie die richtigen Verfahren und Vorschriften kennen und anwenden.

- Überwachung: Überwachung der Arbeitsumgebung, um potenzielle Gefahren zu erkennen und zu beseitigen.

- Regelmäßige Überprüfungen: Regelmäßige Überprüfungen der Arbeitsbedingungen und -praktiken, um sicherzustellen, dass sie den Vorschriften entsprechen.

- Technologie: Einsatz von Technologie wie Computerüberwachung und -warnsysteme, um potenzielle Gefahren zu erkennen und zu melden.

- Kultur: Förderung einer Kultur der Arbeitssicherheit, bei der alle Mitarbeiter verantwortungsbewusst und proaktiv bei der Verhinderung von Unfällen mitarbeiten.

Es ist wichtig zu beachten, dass die Überwachung und Sicherstellung der Arbeitssicherheit ein fortlaufender Prozess ist, der ständig überprüft und verbessert werden muss, um sicherzustellen, dass alle Mitarbeiter sicher arbeiten können.

AUVA: Wie kann KI eingesetzt werden, um die Schulung von Mitarbeiter:innen zu unterstützen und sicherzustellen, dass sie über die erforderlichen Fähigkeiten und Kenntnisse verfügen, um sicher zu arbeiten?

ChatGPT: KI kann auf folgende Arten eingesetzt werden, um die Schulung von Mitarbeitern zu unterstützen und sicherzustellen, dass sie über die erforderlichen Fähigkeiten und Kenntnisse verfügen, um sicher zu arbeiten:

- Personalisierte Schulung: KI kann verwendet werden, um personalisierte Schulungen für Mitarbeiter basierend auf ihren individuellen Bedürfnissen und Stärken zu erstellen.

- Echtzeit-Feedback: KI-Systeme können eingesetzt werden, um Mitarbeiter in Echtzeit zu überwachen und Feedback zu ihren Leistungen zu geben, um ihre Fähigkeiten zu verbessern.

- Überwachung des Lernfortschritts: KI kann verwendet werden, um den Lernfortschritt von Mitarbeitern zu überwachen und zu überprüfen, ob sie die erforderlichen Kenntnisse und Fähigkeiten erworben haben.

- Simulationen: KI kann verwendet werden, um realistische Arbeitsumgebungen und -szenarien zu simulieren, um Mitarbeiter auf potenzielle Gefahren vorzubereiten und ihre Reaktionen zu verbessern.

Es ist jedoch wichtig zu beachten, dass KI-Systeme nicht als Ersatz für menschliche Instruktoren oder Überwacher verwendet werden sollten, sondern als ergänzende Werkzeuge, um die Schulung von Mitarbeitern zu verbessern und zu unterstützen.

AUVA: Wie kann KI bei der Überwachung von Arbeitsbedingungen und der Identifizierung von Risiken eingesetzt werden?

ChatGPT: KI kann bei der Überwachung von Arbeitsbedingungen und der Identifizierung von Risiken auf folgende Arten eingesetzt werden:

- Sensoren und Überwachungsgeräte: KI kann mit sensorenbasierten Systemen wie Kameras, Bewegungsdetektoren und Umweltüberwachungsgeräten verbunden werden, um potenzielle Gefahren zu erkennen und zu melden.

- Predictive Maintenance: KI-Systeme können verwendet werden, um maschinelle Systeme zu überwachen und vorherzusagen, wann Wartungsarbeiten erforderlich sein werden, um potenzielle Ausfälle und Gefahren zu vermeiden.

- Datenanalyse: KI-Systeme können große Datenmengen aus unterschiedlichen Quellen analysieren, um Muster und Trends in Bezug auf Arbeitsbedingungen und Risiken zu erkennen und Vorhersagen zu treffen.

- Simulationen: KI-Systeme können verwendet werden, um Szenarien zu simulieren und mögliche Auswirkungen von Änderungen an Arbeitsbedingungen oder Prozessen zu bewerten, um potenzielle Risiken zu minimieren.

Es ist jedoch wichtig zu beachten, dass KI nur ein Werkzeug ist und dass menschliche Überwacher und Experten auch weiterhin eine wichtige Rolle bei der Überwachung von Arbeitsbedingungen und der Identifizierung von Risiken spielen.

Interview Teil 2: "Die Frage nach der Datenqualität"

Im zweiten Teil des Interviews befragte ich ChatGPT, wie es mit seiner Datenqualität aussieht. Welcher Daten bedient sich ChatGPT und kann man sich sicher sein, dass die Informationen in den Antworten von ChatGPT richtig sind …?

AUVA: Wie sieht es mit der Datenqualität aus?

ChatGPT: Um sicherzustellen, dass die Daten, die verwendet werden, um Sprachmodelle zu trainieren, qualitativ hochwertig sind, gibt es einige Schritte, die man unternehmen kann:

- Datenaufbereitung: Es ist wichtig, dass die Daten gereinigt und aufbereitet werden, bevor sie verwendet werden, um das Modell zu trainieren. Dies kann dazu beitragen, ungenaue oder unvollständige Daten zu entfernen.

- Annotation: Es ist wichtig, dass die Daten korrekt annotiert werden, um sicherzustellen, dass das Modell die richtigen Informationen aus den Daten extrahiert.

- Datenmenge: Es ist wichtig, dass das Modell ausreichende Menge an Daten hat, um eine genaue Vorhersage zu treffen. Ein Mangel an Daten kann dazu führen, dass das Modell ungenau ist.

- Balanced Data: Es ist wichtig, dass die verwendeten Daten ausgewogen sind, um sicherzustellen, dass das Modell in der Lage ist, mit verschiedenen Arten von Eingabe umzugehen und nicht Überfitting zu erzeugen

- Datenqualitätskontrolle: Es ist wichtig, regelmäßig die Qualität der Daten zu überprüfen, um sicherzustellen, dass sie korrekt und vollständig sind. Dies kann durch manuelle Überprüfung oder durch die Verwendung von Tools zur automatischen Datenqualitätskontrolle erfolgen.

- Diversität: Es ist wichtig, dass die Daten divers sind, um sicherzustellen, dass das Modell in der Lage ist, mit verschiedenen Akzenten, Sprachen und Umgebungen umzugehen.

- Datenschutz: Es ist wichtig, dass die Daten sicher und geschützt sind und dass die Datenschutzrichtlinien eingehalten werden.

- Update: Es ist wichtig, dass die Daten regelmäßig aktualisiert werden, um sicherzustellen, dass das Modell auf dem neuesten Stand bleibt und auf Veränderungen in der Umgebung reagieren kann.

Es ist wichtig zu betonen, dass die Qualität der Daten ein wichtiger Faktor ist, um sicherzustellen, dass das trainierte Sprachmodell verlässliche und genaue Ergebnisse liefert. Eine sorgfältige Aufbereitung und Annotation der Daten, sowie regelmäßige Überprüfungen und Aktualisierungen, können dazu beitragen, dass das Modell auf einer soliden Grundlage trainiert wird und zuverlässige Ergebnisse liefert.

AUVA: Was meinen Sie mit „Daten bereinigen“?

ChatGPT: Datenbereinigung bezieht sich auf den Prozess der Durchführung von Schritten, um die Daten, die verwendet werden, um ein Sprachmodell zu trainieren, zu bereinigen und vorzubereiten. Dies kann einige der folgenden Schritte umfassen:

- Duplikaten-Entfernung: Entfernen von doppelten Daten, um sicherzustellen, dass das Modell nicht auf die gleichen Daten mehrfach trainiert wird.

- Löschen von unbrauchbaren Daten: Entfernen von Daten, die nicht relevant sind oder nicht für das Modell verwendet werden können.

- Fehlerkorrektur: Korrektur von Fehlern in den Daten, wie z.B. Tippfehler oder fehlende Werte.

- Formatierung: Konvertieren der Daten in ein einheitliches Format, um sicherzustellen, dass das Modell die Daten lesen und verarbeiten kann.

- Normalisierung: Anpassen der Daten, um sicherzustellen, dass sie in einem bestimmten Bereich liegen.

Dieser Prozess dient dazu, die Daten so vorzubereiten, dass das trainierte Modell auf sauberen und qualitativ hochwertigen Daten trainiert wird und dadurch die Genauigkeit der Ergebnisse erhöht werden kann.

AUVA: Wie sieht die Schnittstelle zwischen dem Menschen und KI aus bzw. wie erfolgt die Übermittlung von KI-Ergebnissen an die Mitarbeiter:innen in der Automatisierung?

ChatGPT: Die Übermittlung von Ergebnissen von Sprachmodellen an die Mitarbeiter in der Automatisierung kann auf verschiedene Weise erfolgen:

- Benutzeroberfläche: Eine Benutzeroberfläche kann bereitgestellt werden, die es den Mitarbeitern ermöglicht, die Ergebnisse des Modells einfach und intuitiv anzuzeigen. Die Benutzeroberfläche kann in Form von Dashboards oder Reports erfolgen, die es ermöglichen, die Ergebnisse in Echtzeit oder in historischen Daten zu verfolgen.

- Alarmierung: Eine Alarmierung kann eingesetzt werden, um die Mitarbeiter auf potenzielle Gefahren oder Abweichungen von normalen Prozessen aufmerksam zu machen. Die Alarmierung kann per E-Mail, SMS oder über eine mobile App erfolgen.

- Schulungen: Es ist wichtig, dass die Mitarbeiter entsprechend geschult werden, um die Ergebnisse des Modells richtig zu interpretieren und angemessen darauf zu reagieren.

- Dokumentation: Es ist wichtig, dass die Ergebnisse des Modells dokumentiert werden, um sicherzustellen, dass die Ergebnisse nachvollziehbar sind und dass potenzielle Gefahren nachverfolgt werden können.

- Automatisierung: Es ist wichtig, dass die Ergebnisse des Modells automatisch in die Prozesse eingebunden werden, um sicherzustellen, dass die Ergebnisse schnell und effektiv genutzt werden können.

Es ist wichtig, dass die Übermittlung der Ergebnisse des Modells an die Mitarbeiter in der Automatisierung klar, einfach und intuitiv erfolgt, um sicherzustellen, dass die Ergebnisse schnell und effektiv genutzt werden können und dass potenzielle Gefahren schnell erkannt und behoben werden können.

AUVA: Eine falsche Information in der Automatisierung kann aber zu Unfällen führen?

ChatGPT: Ja, eine falsche Information, die in der Automatisierung verwendet wird, kann zu Unfällen führen. Es ist wichtig, dass die Ergebnisse des Sprachmodells genau und zuverlässig sind, um sicherzustellen, dass die Automatisierung sicher und effektiv funktioniert. Fehlerhafte Ergebnisse können dazu führen, dass Maschinen oder Anlagen falsch gesteuert werden und potenzielle Gefahren für die Bedienpersonen oder die Umwelt entstehen. Es ist daher wichtig, dass regelmäßig die Qualität der Daten überprüft wird, die verwendet werden, um das Modell zu trainieren, sowie die Ergebnisse des Modells zu überprüfen, um sicherzustellen, dass sie korrekt und zuverlässig sind. Es ist auch wichtig, dass das Personal entsprechend geschult wird, um die Ergebnisse des Modells richtig zu interpretieren und angemessen darauf zu reagieren.

AUVA: Muss man jedes Ihrer Ergebnisse von Experten:Expertinnen überprüfen lassen?

ChatGPT: Es ist wichtig, dass die Ergebnisse des Sprachmodells regelmäßig von qualifiziertem Personal überprüft werden, um sicherzustellen, dass sie korrekt und zuverlässig sind. Eine solche Überprüfung kann dazu beitragen, potenzielle Fehler im Modell zu erkennen und zu korrigieren und sicherzustellen, dass das Modell die Anforderungen und Standards erfüllt.

Es ist auch wichtig die Ergebnisse des Modells mit anderen Faktoren wie manuelle Überwachung und Schulungen zu kombinieren und sicherzustellen, dass die Bedienpersonen die richtigen Befehle und Anweisungen geben und die Ergebnisse des Modells richtig interpretieren. Es ist auch wichtig zu betonen, dass eine regelmäßige Wartung und Überwachung des Modells erforderlich ist, um sicherzustellen, dass es ordnungsgemäß funktioniert und potenzielle Gefahren frühzeitig erkennt.

Ich wollte darüber hinaus testen, welche Informationen die KI bei einem nicht-technischen Thema der Arbeitssicherheit liefert und habe einige Fragen zu Arbeitspsychologie bzw. der Evaluierung psychischer Belastungen gestellt:

AUVA: Was verstehen Sie unter Evaluierung psychischer Belastung?

ChatGPT: Die Evaluierung der psychischen Belastung bezieht sich auf den Prozess, bei dem das Ausmaß an Stress, Anspannung oder Unbehagen, das eine Person in Bezug auf ihre Arbeit oder ihr Leben erfährt, gemessen wird. Diese Messung kann durch Fragebögen, Interviews oder physiologische Tests durchgeführt werden und kann helfen, die Auswirkungen von Stress auf die Gesundheit und das Wohlbefinden einer Person zu verstehen und zu bewerten.

AUVA: Welche Daten brauchen Sie für die Evaluierung psychischer Belastung?

ChatGPT: Um die psychische Belastung zu evaluieren, werden normalerweise eine Reihe von Daten gesammelt, einschließlich:

- Demografische Informationen: Alter, Geschlecht, Bildungsniveau, berufliche Informationen etc.

- Arbeitsbedingungen: Arbeitszeiten, Arbeitsbelastung, Arbeitsumgebung, Arbeitskultur etc.

- Lebensbedingungen: Familiensituation, Wohnumfeld, finanzielle Situation etc.

- Emotionale Reaktionen: Angst, Depression, Stresssymptome etc.

- Verhaltensweisen: Schlafgewohnheiten, Konsumgewohnheiten (Alkohol, Zigaretten etc.), körperliche Aktivität etc.

- Physiologische Daten: Herzfrequenz, Blutdruck, Kortisolspiegel etc.

Diese Daten werden normalerweise durch Fragebögen, Interviews oder physiologische Tests gesammelt, um ein umfassendes Bild der psychischen Belastung einer Person zu erhalten.

Anmerkung:

Gleich zu Beginn führt uns die KI auf einen falschen Weg, denn für die Evaluierung psychischer Belastung sollten jene Einflüsse gemessen werden, die „von außen auf den Menschen zukommen und psychisch auf ihn einwirken“. Bei den hier beschriebenen Faktoren wie Stress und Anspannung, aber auch Monotonie und Ermüdung, handelt es sich um Beanspruchungen, also die Auswirkungen der psychischen Belastung auf ein Individuum. Auch bei den zu erhebenden Daten verweist die KI hauptsächlich auf Daten der Beanspruchung von Mitarbeitenden. Nur Punkt 2 der Antwort von ChatGPT bezieht sich wirklich auf die psychische Belastung und stimmt in etwa mit den vier Dimensionen – Arbeitstätigkeit, Sozial- und Organisationsklima, Arbeitsumgebung und Arbeitsorganisation – überein.

Da die KI kein neues Wissen generiert, sondern in ihren Antworten auf bestehende Texte zurückgreift, stellt sich die Frage, inwieweit es auch in der Arbeitswelt zu dem Missverständnis kommt, dass es bei der Evaluierung psychischer Belastung um die Erhebung individueller Beanspruchung oder gar die Frage nach psychischen Erkrankungen der Mitarbeitenden geht, anstatt um die Erhebung von Arbeitsbedingungen. Die Antwort von ChatGPT legt also nahe, dass es auch in den zugrundeliegenden Informationen eine Vermischung von Belastung und Beanspruchung gibt.

Als Konsequenz ergibt sich erstens daraus, dass die KI gut genutzt werden kann, um sich Ideen zu einem Thema zu holen, dass es jedoch zum derzeitigen Stand der Technik absolut notwendig ist, die gelieferten Informationen zu hinterfragen und auf Richtigkeit zu überprüfen. Dies erweist sich aufgrund der fehlenden Quellenangaben jedoch oftmals als schwierig. Zweitens wird die Notwendigkeit deutlich, dass wir alle bei der Erstellung von Texten sorgfältig arbeiten, in unserem Beispiel die klare Trennung zwischen Belastung und Beanspruchung, da diese Texte zu Quellen für zukünftige Antworten von KIs werden können.

Interview Teil 3: "Gleiche Frage – gleiche Antwort?"

Im dritten Teil wollte ich testen, was passiert, wenn man die gleiche Frage wiederholt. Wird ChatGPT immer die gleiche Antwort geben? Ich habe festgestellt, dass die KI die Satzstellung in ihren Antworten ändert und Erklärungen variiert, wenn man die gleiche Frage wiederholt. Das ist vielleicht eine gute Sache, wenn man die erste Antwort nicht versteht und eine Frage nochmals anders beantwortet und erklärt haben möchte. Es bedeutet aber auch, dass die Antworten von ChatGPT in wissenschaftlichen Texten nicht verwendbar sind, denn sie sind nicht zitier- bzw. referenzierbar, da sie sich konstant ändern.

Ich habe diese Funktion mit dem Begriff „Outlier Detection“ auf die Probe gestellt:

AUVA: Was ist „Outlier Detection“?

ChatGPT: Outlier Detection (Anomalie-Erkennung oder Ausreißer-Erkennung) ist ein Prozess zum Identifizieren von Datenpunkten, die signifikant von anderen Datenpunkten in einem Datensatz abweichen.

AUVA: Können Sie uns einige Beispiele nennen, wo „Outlier Detection“ eingesetzt werden kann?

ChatGPT: Methode „Outlier detection“ wird in einer Vielzahl von Anwendungen verwendet, darunter:

- Fraud detection: Identifizierung von ungewöhnlichen Transaktionsmustern, die auf betrügerisches Verhalten hinweisen können.

- Quality control: Erkennung von Produktionsfehlern oder -mängeln, die durch ungewöhnliche Datenwerte aufgedeckt werden können.

- Network security: Erkennung von ungewöhnlichen Verhaltensmustern von Netzwerkgeräten oder Benutzern, die auf Angriffe oder Sicherheitsverletzungen hinweisen können.

- Healthcare: Identifizierung von ungewöhnlichen Patientendaten, die auf unerwartete Gesundheitsprobleme hinweisen können.

- Finance: Identifizierung von ungewöhnlichen Aktienkursbewegungen oder Handelsmustern, die auf Insiderhandel oder andere unerwünschte Aktivitäten hinweisen können.

Anmerkung: Da sich die Antwort auf die Methode „Outlier Detection“ bezog, die in einer Vielzahl von Anwendungen eingesetzt wird, fragte ich nach weiteren Beispielen aus dem Bereich der Produktion und erhielt die folgenden Ergebnisse:

- Produktion: Erkennung von Ausreißern in Produktionsdaten, die auf Probleme mit der Maschinerie oder dem Produktionsprozess hinweisen könnten.

- Produktion: Erkennen von Ausreißern in Produktionsparametern, die auf Fehler in der Ausrüstung oder Prozessen hinweisen können.

- Qualitätskontrolle in der Produktion: Identifizierung von Produkten, die nicht den Spezifikationen entsprechen.

- Erkennung von fehlerhaften oder ausfallenden Messdaten in Produktionsprozessen

- Produktion: Erkennung von Ausreißern in Produktionsprozessen, die auf einen Fehler hinweisen können

- Identifizierung von defekten Geräten in einer Produktionsumgebung

- Überwachung von Produktionsprozessen, um Ausreißer in Bezug auf Qualität, Leistung oder Energieverbrauch zu erkennen

- Überwachung von Maschinenparametern, um frühzeitig auf mögliche Fehler oder Wartungsbedarf hinzuweisen

- Ein Beispiel aus der Produktion könnte die Überwachung von Produktionsdaten in einer Fabrik sein.

Anmerkung: An diesem Beispiel wird deutlich, dass sowohl ähnliche als auch gleiche Antworten gegeben werden, nur sind sie anders formuliert.

Fazit

Das KI-Tool ChatGPT ist ein leistungsfähiges Sprachmodell, mit dem man Texte generieren, übersetzen, Fragen beantworten, Konversation führen, Grammatik verbessern, Texte zusammenfassen, Rezepte aus vorhandenen Zutaten vorschlagen, Geschichten und Gedichte erstellen, Programmieren in Python, Java, C++, Go, JavaScript, Matlab kann. Es ist in der Lage, natürliche Sprache zu verstehen und zu erzeugen. Neue Funktionalitäten werden laufend hinzugefügt.

Solche auf KI-Technologie basierenden Tools haben einige Vorteile gegenüber Suchmaschinen wie z. B.:

- Interaktivität: KI-basierte Chats können auf Anfragen in natürlicher Sprache antworten und eine Konversation führen, während Suchmaschinen hauptsächlich darauf abzielen, Anfragen mit vorhandenen Informationen zu beantworten.

- Personalisierung: KI-Chat kann personalisierte Antworten generieren, indem es den Kontext des Dialogs und des Nutzers berücksichtigt.

Allerdings greift der KI-Chat nicht auf alle Informationen zu, die von Suchmaschinen indiziert werden, sondern nur auf bestimmte, bereinigte Daten. Zum Beispiel beinhaltet das getestete Tool laut Angaben des Herstellers Daten bis zum Jahr 2021. Das heißt, dass im Chat die aktuellsten Themen nicht berücksichtigt werden können.

Da das Softwareprogramm ständig weiterentwickelt und der Zugriff auf die Daten erweitert wird, werden die generierten Texte allerdings mit jeder neuen Chat-Version anders ausfallen und vermutlich präziser werden.

Der Test hat zudem gezeigt: Eine KI braucht qualitativ hochwertige Daten, um die richtigen Antworten geben zu können. Zu diesem Zweck müssen viele Daten gesammelt, geprüft und bereinigt werden, was viel Zeit in Anspruch nimmt, und ein Netz spezialisierter Partnerunternehmen erfordert.

Da sich das Internet jedoch zu einer schnellen Informationsplattform mit korrekten und echten, aber auch falschen oder gefälschten Informationen entwickelt hat, ist es außerordentlich schwierig, alle Daten im Internet in Echtzeit zu überprüfen und zu bereinigen. Dadurch leidet die Qualität der Informationen, gerade bei Dialogen mit KI-Tools über in diesem Moment gerade aktuelle Themen. Der zeitliche Abstand zwischen aktuell veröffentlichten Informationen und jenen Daten, auf die eine KI zugreift, wird sich aber wahrscheinlich in Zukunft deutlich verkürzen. Darüber hinaus besteht die Gefahr, dass Informationen in Zukunft nur noch von Chatbots geschrieben werden, die auch zur Verbreitung von Falschinformationen oder zur Manipulation genutzt werden können.

Die hohe Qualität der nachempfundenen natürlichen Sprache, etwa von ChatGPT, kann auch daran erkannt werden, dass eine Software zur Erkennung von Plagiaten in wissenschaftlichen Arbeiten solche generierten Texte noch nicht exakt einer KI zuordnen kann.

Inzwischen hat auch OpenAI das eigene Tool „AI Text Classifier“ (Link: https://platform.openai.com/ai-text-classifier) veröffentlicht, das KI-generierte Texte erkennen sollte. Die Tests zeigten jedoch, dass das Tool 26 % der von der KI generierten Texte erkannte und gleichzeitig 9 % der von Menschen geschriebenen Texte der KI zuordnete. (Watson.ch, 2023)

Wenn die Testergebnisse stimmen sollten, würde das bedeuten, dass die Art und Weise, wie ein Mensch denkt, immer mehr einem Computer ähnelt. Konrad Zuse – Erfinder des ersten funktionsfähigen Computers der Welt, Z3, 1941 – hat gesagt „Die Gefahr, dass der Computer so wird wie der Mensch, ist nicht so groß wie die Gefahr, dass der Mensch so wird wie der Computer.“ (Gutezitate.com, 2023)

Wegen solcher KI-Technologien und deren rasanter Entwicklung im Bereich natürliche Sprache überlegen Schulen wieder dazu überzugehen, Arbeiten und Aufgaben von Schüler:innen in handschriftlicher Form erledigen zu lassen, anstatt diese auf Laptops zu schreiben (Gmeiner, 2023). Auch einige Konferenz-Organisatoren verbieten bereits ausdrücklich die Verwendung von KI zum Schreiben von Papers, da es nicht möglich ist, die Antworten einer KI zu referenzieren und der verwendete Quelltext nicht bekannt ist. (Bastian, 2023)

Aufgrund dieses Interviews kann festgestellt werden, dass sich KI bzw. Instrumente wie ChatGPT zu einer Ergänzung zu herkömmlichen Suchmaschinen entwickeln. Sie liefern schneller erste Informationen zu bestimmten Themen. Mit dem Dialog können Schlagwörter erhalten werden, nach denen weiter über Suchmaschinen gezielt gesucht werden kann. Als Erstinformation zu einem bestimmten Thema ist der Chat hilfreich und schneller als die derzeitige Suche nach Dokumenten, die einzeln durchgelesen werden müssen.

Im Allgemeinen ist das Thema Gesundheit und Sicherheit am Arbeitsplatz im Chat gut vertreten. Informationen zu normativen und gesetzlichen Regelungen sind vorhanden. Grundlegende Informationen zu Ergonomie, Arbeitspsychologie, Arbeitsmedizin und anderen Disziplinen sind verfügbar, wobei die Antworten immer einer Plausibilitätsprüfung unterzogen werden müssen. Da die KI anhand von Wahrscheinlichkeiten ermittelt, wie Wörter und Textsegmente aneinandergereiht werden, werden völlig neue Sätze gebildet. Diese Sätze können nicht über die Suchmaschinen gefunden werden, so dass es nicht möglich oder sehr schwierig ist, Informationen zu überprüfen, die man selbst nicht kennt. Wir empfehlen daher, ChatGPT nur in Bereichen zu verwenden, in denen man sich gut auskennt.

Bei technischen Detailfragen zu bestimmten Arbeitsplätzen und Anwendungssystemen, fällt der ChatGPT jedoch durch.